Emotionen von Politikern analysieren

INTERACT ermöglicht den Vergleich zwischen automatisch erfassten und manuell kodierten Emotionen. Erfahren Sie hier, wie generierte Emotionswerte mit eigenen Verhaltensbeobachtungen kombiniert werden können.

Problemdefinition und Zielbeschreibung:

Um die Qualität von automatisch generierten Emotionsdaten bewerten zu können, sollen diese mit manuell kodierten Verhaltenscodes verglichen werden.

Das Ziel ist:

- Vergleich der Zeiträume der manuell kodierten Mimik „positiv“ und der automatisch ermittelten Emotionswerte „happy“.

Die Umsetzung:

Studiendesign

Die verwendete Quelle ist eine aufgezeichnete Fernsehdebatte zwischen den Politikern Frau Angela Merkel (CDU) und Herrn Peer Steinbrück (SPD).

Tools für die Datenerhebung und Auswertung

Mithilfe der Microsoft Emotionen API Service*, wurde jedes einzelne Frame des Videos analysiert. In der Datei wurde automatisch ausgegeben, welche Emotion das Gesicht des im Bild zu Sehenden ausdrückt. (*) https://azure.microsoft.com/de-de/services/cognitive-services/emotion/

Es wird Mangold INTERACT verwendet, um den Videoinhalt in mehreren Durchgängen zu kodieren.

Das Addon Mangold DataView hilft dabei die automatisch ermittelten Emotionen zu visualisieren und diese Emotionszeiträume nach Mangold INTERACT zu extrahieren. Signifikante Emotionen können in den Daten durch die Überschreitung von Messparametern bestimmt werden.

Manuelle Datenerhebung

Für die manuelle Datenerhebung werden Code-Definitionen vorbereitet. Damit wird das Video in mehreren aufeinanderfolgenden Durchgängen kodiert.

Kamerabild: Nach Aktivierung der lexikalischen Kodiermethode lassen sich Perspektivwechsel einfach mithilfe der Leertaste kodieren. Am Ende eines jeden Schnitts, stoppt das Video und es kann erfasst werden, welche Person im Videobild zu sehen war.

Sprecher: Im Standard Kodiermodus wird, mit einfachen, sich gegenseitig ausschließenden Codes, festgehalten, wer gerade spricht.

Mimik: Für die Eingabe der interpretierten Mimik "positiv" oder "negativ" eignen sich ebenso sich gegenseitig ausschließende Codes und der Standard Kodiermodus.

Gemeinsame Datenanalyse

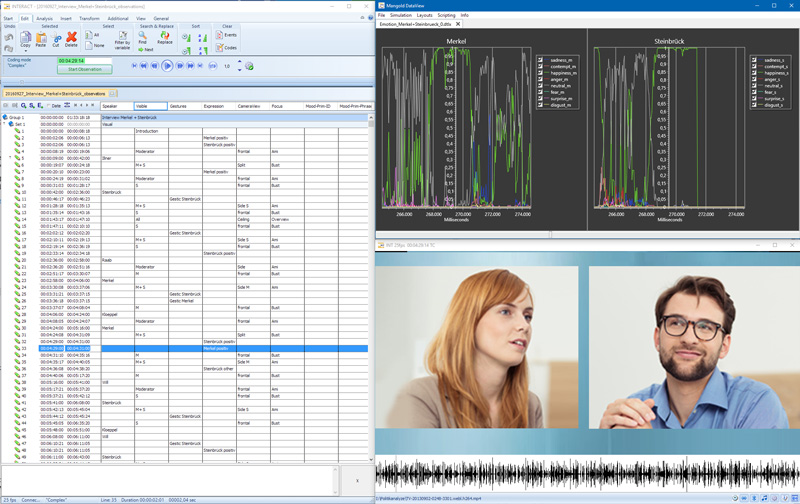

Die automatisch ermittelten Emotionswerte werden in das Addon Mangold DataView importiert.

Nach dem erfolgreichen Import der Emotionsdaten und der Layoutbestimmung (ein Emotionsdiagramm pro Person) sieht der Aufbau für die Analyse wie folgt aus:

Nun lassen sich Messwerte mit Mangold DataView synchron zu den in Mangold INTERACT geöffneten Videos und den manuell kodierten Verhaltensbeobachtungen darstellen.

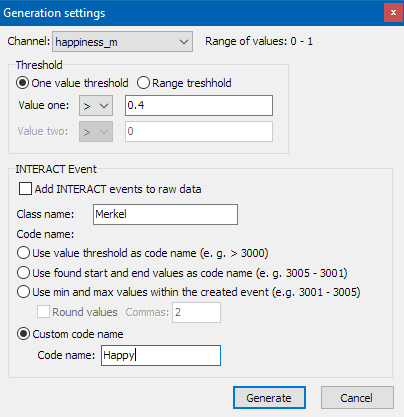

Auf Basis der Emotions-Messwerte werden Ereignisse für Mangold INTERACT erstellt.

Mit den in DataView vorhandenen Skripts kann ein Kanal und der passende Schwellenwert ausgewählt werden. Auf diese Weise können Ereignisse für alle Phasen erstellt werden, in welchen der „Happy“-Kanal von Frau Angela Merkel und Herrn Peer Steinbrück auf einen Wert über 0.4 ansteigt.

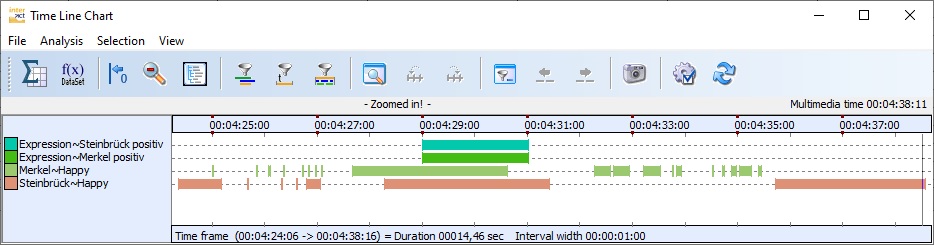

Jetzt kann das Zeitdiagramm zu der manuell kodierten „positiven“ Mimik und den automatisch erfassten Ereignissen für „Happy“ miteinander verglichen werden.

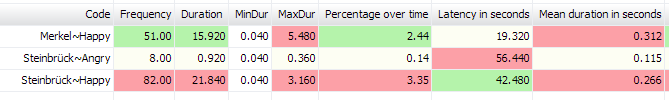

Des Weiteren verrät die Statistik der automatisch generierten Emotionswerte, dass Herr Peer Steinbrück sehr oft als „happy“ eingestuft werden konnte. Dieses Verhalten dauert jedoch für gewöhnlich weniger als eine halbe Sekunde an: